LLM 추론 실패 Part 1: 구조적 한계 -- 스케일링으로 못 고친다

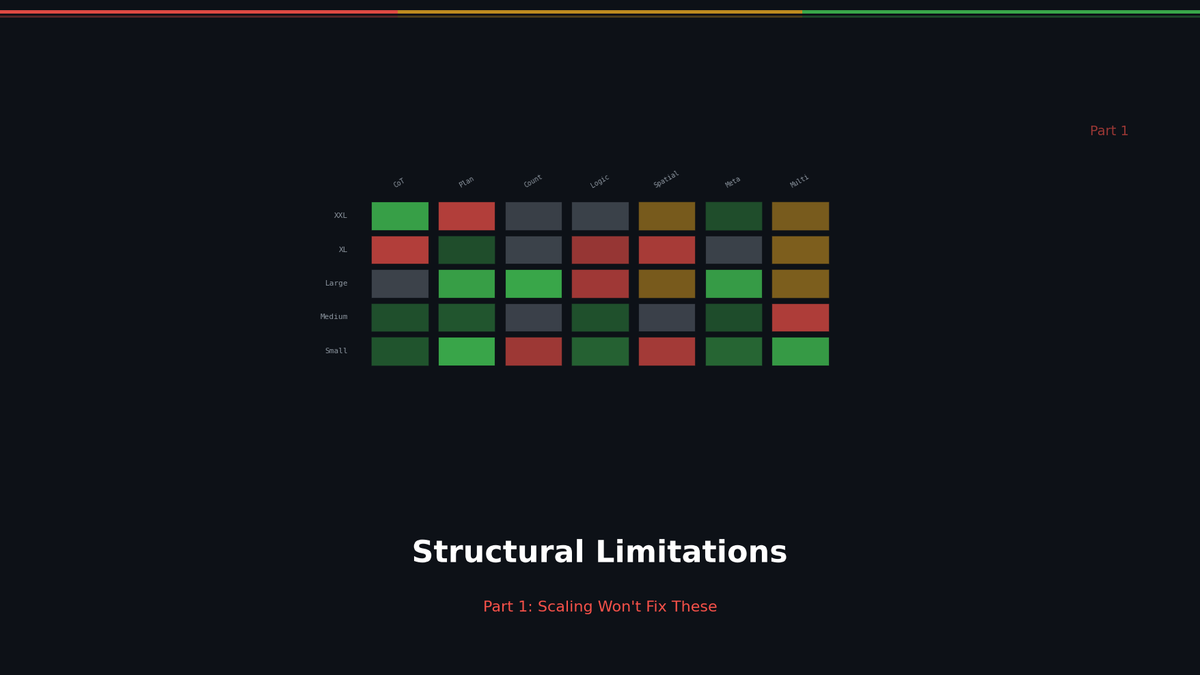

Reversal Curse, Counting, Compositional Reasoning — Transformer 아키텍처에 뿌리를 둔 구조적 실패를 7개 모델로 실험합니다.

LLM 추론 실패 Part 1: 구조적 한계 -- 스케일링으로 못 고친다

LLM이 실패하는 이유를 분석하는 시리즈의 첫 번째 편입니다. 이번 글에서는 모델을 아무리 키워도, 데이터를 아무리 더 줘도 해결되지 않는 구조적(fundamental) 한계 세 가지를 다룹니다.

- Reversal Curse

- Counting Failures

- Compositional Reasoning Wall

이 실패들은 Transformer 아키텍처 자체에서 비롯됩니다. 프롬프트 엔지니어링이나 스케일링으로는 근본적으로 해결할 수 없습니다. Song, Han, Goodman (2025)의 서베이 논문을 바탕으로, 7개 모델을 직접 실험한 결과를 함께 정리합니다.

1. Reversal Curse

논문이 말하는 것

"A는 B다"를 학습한 모델이 "B는 A다"를 추론할 수 있을까? Song et al. (2025)는 이를 Reversal Curse라 부릅니다. Transformer의 next-token prediction(단방향 학습)은 "A → B" 방향의 가중치만 강화합니다. "B → A"는 별도로 학습하지 않으면 추론할 수 없습니다.

더 중요한 건, 이 문제가 Zipf의 법칙 때문에 스케일링으로 해결되지 않는다는 점입니다. 학습 데이터에서 "톰 크루즈의 어머니는 메리 리 파이퍼"라는 문장은 나올 수 있지만, "메리 리 파이퍼의 아들은 톰 크루즈"라는 문장은 훨씬 드뭅니다. 유명인의 이름이 주어일 때와 무명인의 이름이 주어일 때, 데이터 분포의 비대칭이 구조적으로 존재합니다.

관련 포스트

스스로 진화하는 AI 에이전트 — 2026년의 새로운 패러다임

GenericAgent, Evolver, Open Agents — 스스로 스킬을 만들고, 실행 경로를 기억하고, 실패에서 배우는 자가 진화 에이전트 3종 비교.

나만의 LLM Knowledge Base 구축하기 — Karpathy 스타일 지식 시스템

Obsidian + Claude Code로 영구적인 개인 지식 체계를 만드는 완전 가이드. 위키 + 메모리 두 축의 지식 시스템.

Karpathy의 CLAUDE.md가 48K 스타를 받은 이유 — 그리고 나만의 CLAUDE.md 작성법

마크다운 파일 하나로 AI 코딩 정확도를 65%에서 94%로. Karpathy의 4가지 규칙과 실전 작성법을 분석합니다.