SAE Lens와 TensorLens: Feature Interpretability의 시대

뉴런은 해석 불가능하다. Sparse Autoencoder가 모델 내부의 monosemantic feature를 추출하고, TensorLens가 Transformer 전체를 하나의 텐서로 통합 분석하는 최신 interpretability를 정리한다.

SAE Lens와 TensorLens: Feature Interpretability의 시대

지난 두 글에서 우리는:

- Logit/Tuned Lens: 모델의 중간 예측을 읽었고

- Activation Patching: 어떤 activation이 답의 원인인지 추적했습니다

하지만 여기서 근본적인 문제에 부딪힙니다:

우리가 조작하고 관찰하는 activation은 도대체 무엇을 "의미"하는가?

activation의 각 차원은 개별 뉴런에 대응합니다. 그런데 이 뉴런들은 polysemantic(다의적)합니다. 하나의 뉴런이 학술 인용, 영어 대화, HTTP 요청, 한국어 텍스트에 동시에 반응합니다. 뉴런 단위로는 깨끗한 해석이 불가능합니다.

이 글에서는 이 문제를 해결하는 두 가지 최신 접근법을 다룹니다:

- Sparse Autoencoder (SAE): dense activation을 sparse한 monosemantic feature로 분해

- TensorLens: Transformer 전체 계산을 하나의 high-order tensor로 통합 분석

관련 포스트

AI Research

MIRAGE — 멀티모달 AI는 정말로 이미지를 "보고" 있을까?

GPT-5.1, Gemini 3 Pro, Claude Opus 4.5가 이미지 없이도 벤치마크 점수의 70-80%를 유지. 3B 텍스트 전용 모델이 흉부 X-ray 벤치마크에서 모든 멀티모달 모델과 방사선과 전문의를 능가. 스탠포드 MIRAGE 논문 리뷰.

AI Research

InternVL-U: 4B 파라미터로 이해+생성+편집을 동시에 -- 통합 멀티모달의 새 기준

Shanghai AI Lab의 InternVL-U. 4B 파라미터 단일 모델로 이미지 이해, 생성, 편집, 추론 기반 생성을 모두 수행. 디커플드 비주얼 표현으로 14B BAGEL을 GenEval과 DPG-Bench에서 능가.

AI Research

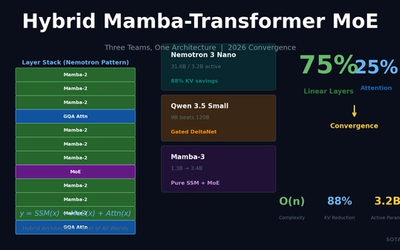

Hybrid Mamba-Transformer MoE: 세 팀이 동시에 도달한 같은 결론 -- 2026년 LLM 아키텍처의 수렴

NVIDIA Nemotron 3 Nano, Qwen 3.5, Mamba-3가 독립적으로 75% 선형 레이어 + 25% 어텐션 + MoE 구조에 수렴. 88% KV-cache 절감, O(n) 복잡도로 긴 컨텍스트 처리.