Hybrid Mamba-Transformer MoE: 세 팀이 동시에 도달한 같은 결론 -- 2026년 LLM 아키텍처의 수렴

NVIDIA Nemotron 3 Nano, Qwen 3.5, Mamba-3가 독립적으로 75% 선형 레이어 + 25% 어텐션 + MoE 구조에 수렴. 88% KV-cache 절감, O(n) 복잡도로 긴 컨텍스트 처리.

Mamba + Transformer + MoE: 세 팀이 동시에 도달한 "최적 아키텍처"의 정체

2026년 3월, 이상한 일이 벌어졌습니다. NVIDIA, Alibaba(Qwen), 그리고 Mamba 팀 -- 서로 독립적으로 연구하던 세 팀이 거의 동시에 같은 결론에 도달했습니다.

"순수 Transformer도 아니고, 순수 SSM도 아닌, 둘을 섞되 약 75% 선형 레이어 + 25% 어텐션 레이어가 최적이다. 여기에 MoE를 더하면 된다."

NVIDIA는 Nemotron 3 Nano를, Qwen 팀은 3.5 Small 시리즈를, Mamba 팀은 ICLR 2026에서 이론적 프레임워크(Mamba-3)를 발표했습니다. 한 팀이 그랬다면 우연일 수 있습니다. 세 팀이 동시에 같은 결론에 도달했다면, 이것은 패러다임 전환의 신호입니다.

이 글에서는 이 수렴 현상의 배경, 각 아키텍처의 기술적 디테일, 그리고 이것이 AI 인프라에 미칠 영향을 분석합니다.

배경: 순수 Transformer의 비용 문제

GPT 이후 6년간, Transformer는 사실상 유일한 LLM 아키텍처였습니다. 하지만 scale이 커질수록 두 가지 근본적 문제가 드러납니다.

1. Self-Attention의 이차 복잡도

Transformer의 핵심인 self-attention은 시퀀스 길이 n에 대해 O(n^2) 연산을 요구합니다. 모든 토큰이 다른 모든 토큰과 상호작용하기 때문입니다. n이 1K일 때와 128K일 때의 차이를 보면:

| 시퀀스 길이 | 어텐션 연산량 (상대값) |

|---|---|

| 1,024 | 1x |

| 8,192 | 64x |

| 32,768 | 1,024x |

| 131,072 | 16,384x |

8배 길어지면 64배 비싸집니다. 128K 컨텍스트는 1K 대비 16,000배 이상의 어텐션 연산을 필요로 합니다.

2. KV-Cache의 메모리 폭발

추론 시, Transformer는 이전에 생성한 모든 토큰의 Key-Value 벡터를 메모리에 유지해야 합니다 (KV-cache). 이 캐시는 시퀀스 길이에 비례해서 선형으로 증가합니다.

70B 모델이 128K 컨텍스트를 처리할 때, KV-cache만으로 수십 GB의 GPU 메모리를 차지합니다. 배치 크기를 늘리기 어렵고, 동시 사용자 수가 제한됩니다. 모바일이나 엣지 디바이스 배포는 사실상 불가능합니다.

이 두 문제를 해결하려는 시도가 State Space Model(SSM) 계열의 연구입니다.

State Space Model 복습: Mamba까지의 여정

State Space Model의 핵심 아이디어는 "모든 토큰이 모든 토큰을 볼 필요는 없다"는 것입니다. 대신, 고정 크기 상태(state)에 정보를 압축하고, 이 상태를 순차적으로 업데이트합니다.

비유하자면: Transformer는 시험 칠 때 모든 교과서를 펼쳐놓고 답을 쓰는 방식입니다 (전체 참조). SSM은 교과서를 다 읽은 후 정리 노트만 보고 답을 쓰는 방식입니다 (압축된 상태).

S4 (2022)

Structured State Space Sequence Model. 연속 시간 상태 방정식을 이산화하여 시퀀스 모델링에 적용했습니다. O(n) 복잡도로 긴 시퀀스를 처리할 수 있었지만, 언어 모델에서 Transformer를 이기지 못했습니다. 상태 전이 행렬이 입력에 무관한 고정값이라, 내용 기반 추론(content-based reasoning)에 약했기 때문입니다.

Mamba (2023)

Gu & Dao의 Mamba는 S4의 가장 큰 약점을 정면으로 해결했습니다. 상태 전이 행렬 A, B, C를 입력에 따라 동적으로 변하게 만든 것입니다 (selective state spaces). 이로써 "어떤 정보를 기억하고, 어떤 정보를 잊을지"를 내용에 따라 선택할 수 있게 되었습니다.

핵심 특성:

- O(n) 복잡도: 시퀀스 길이에 선형 비례하는 연산량

- 고정 크기 상태: KV-cache 없음. 상태 크기가 시퀀스 길이에 무관

- 하드웨어 효율적 구현: GPU의 SRAM과 HBM 사이 데이터 이동을 최적화

Mamba-2 (2024)

Mamba-2는 핵심 연산을 세미스트럭처드 행렬(Semiseparable Matrix) 형태로 재정의하면서, structured state space duality(SSD)를 발견했습니다. Mamba의 selective scan과 linear attention 사이의 수학적 등가성을 증명한 것입니다. 이 이론적 발견이 하이브리드 아키텍처로 가는 문을 열었습니다.

DeltaNet / Gated DeltaNet

Linear attention의 변종인 DeltaNet은 delta rule(오류 보정 학습 규칙)을 적용한 선형 어텐션입니다. Gated DeltaNet은 여기에 게이팅 메커니즘을 추가하여 정보 흐름을 더 정밀하게 제어합니다. Mamba-2와 마찬가지로 O(n) 복잡도를 가지면서, 어텐션에 더 가까운 표현력을 제공합니다.

하이브리드 인사이트: 왜 섞으면 더 좋은가?

순수 SSM(Mamba, DeltaNet 등)은 O(n) 복잡도라는 장점이 있지만, 여전히 순수 Transformer 대비 품질 격차가 존재했습니다. 왜일까요?

고정 크기 상태의 정보 병목

SSM의 상태는 고정된 차원의 벡터입니다. 아무리 긴 시퀀스를 처리해도, 상태의 크기는 변하지 않습니다. 이것은 "정리 노트"의 페이지 수가 제한된 것과 같습니다. 어떤 정보는 불가피하게 손실됩니다.

특히 문제가 되는 작업:

- In-context learning: 프롬프트에 주어진 예시를 정확하게 참조해야 하는 작업

- 정확한 인용/복사: 입력의 특정 부분을 그대로 출력해야 하는 작업

- 복잡한 의존성 추적: 멀리 떨어진 토큰 간의 정밀한 관계를 추적하는 작업

이런 작업에서는 "모든 토큰을 직접 참조"하는 full attention이 구조적으로 유리합니다.

하이브리드의 핵심 통찰: 대부분의 레이어에서는 선형 복잡도의 SSM/linear attention으로 충분하고, 소수의 레이어에서만 full attention이 필요하다.

직관적으로 이렇게 생각할 수 있습니다. 책을 읽을 때 대부분의 시간은 순서대로 흐름을 따라가면 됩니다 (SSM의 역할). 하지만 가끔 앞 부분을 다시 펼쳐서 정확한 내용을 확인해야 할 때가 있습니다 (attention의 역할). 모든 문장마다 처음부터 다시 읽을 필요는 없습니다.

이제 이 아이디어를 실제로 구현한 세 가지 사례를 살펴보겠습니다.

사례 1: NVIDIA Nemotron 3 Nano (30B-A3B)

NVIDIA의 Nemotron 3 Nano는 하이브리드 아키텍처의 가장 완성된 구현 중 하나입니다.

아키텍처 구성

| 항목 | 수치 |

|---|---|

| 총 파라미터 | 31.6B |

| 활성 파라미터 | 3.2B (약 10%) |

| 전체 레이어 수 | 52 |

| Mamba-2 레이어 | 23 (44%) |

| MoE FFN 레이어 | 23 (44%) |

| GQA Attention 레이어 | 6 (12%) |

| 컨텍스트 윈도우 | 128K 토큰 |

52개 레이어 중 attention 레이어는 단 6개입니다. 나머지 46개 레이어는 Mamba-2(선형 복잡도)와 MoE(조건부 연산)로 구성됩니다.

왜 이 비율인가?

NVIDIA의 실험에 따르면, attention 비율을 0%에서 100%까지 변화시키며 성능을 측정했을 때:

- 0% (순수 Mamba): in-context retrieval 작업에서 현저한 성능 저하

- 10~15% attention: 대부분의 벤치마크에서 순수 Transformer와 동등한 성능 회복

- 25% 이상: 추가 attention 레이어의 한계 효용이 급감

6/52 = 약 11.5%의 attention 비율은 이 실험의 sweet spot입니다.

MoE 구성

23개 MoE 레이어는 각각 16개의 expert를 가지며, 입력 토큰당 top-4 expert가 활성화됩니다. 이를 통해 31.6B의 지식 용량을 유지하면서 실제 연산은 3.2B 수준으로 줄입니다.

성능 요약

Nemotron 3 Nano는 비슷한 활성 파라미터 규모의 dense 모델들을 크게 앞서고, 10배 이상 큰 모델들과 경쟁합니다. 특히:

- Phi-4-mini (3.8B dense) 대비 평균 5~8%p 높은 벤치마크 점수

- Llama 3.1 8B와 동등하거나 우위인 성능을, 3.2B 활성 파라미터로 달성

- NVIDIA Jetson 같은 엣지 디바이스에서 실시간 추론 가능

KV-cache 측면에서도 혁명적입니다. 6개 attention 레이어만 KV-cache를 필요로 하므로, 순수 Transformer 대비 KV-cache 메모리 사용량이 약 88% 감소합니다.

사례 2: Qwen 3.5 Small Series -- Gated DeltaNet의 위력

Alibaba의 Qwen 팀은 DeltaNet 계열의 선형 어텐션을 사용한 하이브리드를 제시했습니다.

아키텍처 핵심

Qwen 3.5 Small의 핵심은 Gated DeltaNet과 softmax attention을 3:1 비율로 배치한 것입니다. 즉, 매 4개 레이어 중 3개는 Gated DeltaNet(선형 복잡도), 1개는 full softmax attention입니다. 이것은 attention 비율 25%로, Mamba-3의 이론적 최적 비율과 정확히 일치합니다.

Gated DeltaNet이란?

기존 softmax attention을 떠올려 봅시다:

Attention(Q, K, V) = softmax(Q * K^T / sqrt(d)) * V

이 softmax가 O(n^2)의 원인입니다. Linear attention은 softmax를 제거하고 커널 함수 phi로 대체합니다:

LinearAttn(Q, K, V) = phi(Q) * (phi(K)^T * V)

여기서 핵심 트릭은 결합 순서입니다. phi(K)^T * V를 먼저 계산하면 d x d 행렬이 되고, 이것에 phi(Q)를 곱하면 O(n * d^2)로 시퀀스 길이에 선형입니다.

DeltaNet은 여기에 delta rule을 적용합니다. 각 스텝에서 상태 S를 업데이트할 때, "새로운 정보를 추가"하기 전에 "이전의 관련 정보를 먼저 제거"합니다:

S_t = S_{t-1} - beta_t * (S_{t-1} * k_t) * k_t^T + beta_t * v_t * k_t^T

이것은 연상 메모리(associative memory)에서 오래된 연관을 지우고 새 연관으로 교체하는 것과 같습니다. Gated DeltaNet은 여기에 게이팅 메커니즘(alpha)을 추가하여, 정보의 유지/삭제를 더 세밀하게 제어합니다.

9B가 120B를 이긴다

Qwen 3.5 Small 시리즈의 가장 인상적인 결과는 9B 모델의 성능입니다.

| 벤치마크 | Qwen 3.5 Small 9B | GPT-OSS-120B | 비고 |

|---|---|---|---|

| MMLU-Pro | 높음 | 낮음 | 9B가 120B를 초과 |

| HumanEval+ | 높음 | 비슷 | 코딩 능력 동등 |

| 처리량 | ~10x | 1x | 활성 파라미터 차이 |

9B 하이브리드 모델이 120B dense Transformer를 벤치마크에서 이기는 것은, 이 아키텍처 전환이 단순한 효율성 개선이 아니라 실질적인 성능 향상을 가져다줄 수 있음을 보여줍니다.

사례 3: Mamba-3 -- ICLR 2026의 이론적 기여

Mamba의 원저자인 Albert Gu와 Tri Dao가 이끄는 팀이 ICLR 2026에서 발표한 Mamba-3은 실용적 모델보다는 이론적 프레임워크에 가깝습니다.

핵심 기여

1. 최적 비율의 이론적 도출

Mamba-3 논문은 "왜 약 75% 선형 레이어 + 25% 어텐션 레이어가 최적인가?"에 대한 수학적 답을 제시합니다.

핵심 논증:

- 선형 레이어(SSM/linear attention)는 O(n) 복잡도로 시퀀스의 "흐름"을 처리하는 데 최적

- Full attention은 O(n^2)이지만, precise retrieval(정밀 검색)이 필요한 작업에서 대체 불가능

- 언어 모델의 실제 작업 분포를 분석하면, 정밀 검색이 필요한 비율은 전체의 약 20~30%

- 따라서 25%의 attention이면 충분하고, 나머지 75%를 선형 레이어로 대체하면 전체 추론 비용을 크게 절감

2. Attention Sink 분석

흥미로운 발견은 attention 레이어의 "최적 배치"에 대한 분석입니다. Attention 레이어를 균등하게 분산시키는 것보다, 초반과 후반에 집중시키는 것이 더 효과적이라는 결과를 보여줍니다. 초반 attention은 입력의 전역적 구조를 파악하고, 후반 attention은 출력 생성에 필요한 정밀 참조를 수행합니다.

3. SSM과 Linear Attention의 통합 프레임워크

Mamba-2에서 발견한 SSD(Structured State Space Duality)를 확장하여, Mamba 계열과 DeltaNet 계열을 동일한 수학적 프레임워크로 통합합니다. 이를 통해 "어떤 선형 레이어를 쓸 것인가"는 구현의 선택지일 뿐, 근본적으로 같은 연산 클래스라는 것을 증명했습니다.

이것이 NVIDIA가 Mamba-2를, Qwen이 Gated DeltaNet을 선택했지만 결과적으로 비슷한 성능을 보이는 이유를 설명해줍니다.

성능 비교: 숫자로 보는 하이브리드의 효과

세 아키텍처의 핵심 특성을 비교합니다:

| 특성 | Nemotron 3 Nano | Qwen 3.5 Small 9B | 순수 Transformer (동급) |

|---|---|---|---|

| 총 파라미터 | 31.6B | ~9B | ~8B |

| 활성 파라미터 | 3.2B | ~9B | ~8B |

| 선형 레이어 비율 | 88% | 75% | 0% |

| KV-cache 크기 (128K) | ~12% of full | ~25% of full | 100% |

| 추론 속도 (상대값) | ~3~4x | ~2~3x | 1x |

| 메모리 효율 | 매우 높음 | 높음 | 기본 |

KV-cache 절감 효과

이것이 실제 배포에서 가장 큰 차이를 만드는 부분입니다.

순수 Transformer에서 128K 컨텍스트의 KV-cache 크기를 계산해 봅시다. 40개 레이어, hidden dim 4096, GQA 8 헤드 기준:

KV-cache = 2 (K + V) * 40 (layers) * 128,000 (seq_len) * 512 (head_dim * n_kv_heads) * 2 (bytes, FP16) = 약 10.5 GB

Nemotron 3 Nano는 6개 레이어만 KV-cache가 필요하므로:

KV-cache = 2 * 6 * 128,000 * 512 * 2 = 약 1.6 GB

같은 컨텍스트 길이에서 약 85% 메모리 절감입니다. 이 차이는 동시 서빙 가능한 사용자 수, 배치 크기, 그리고 엣지 배포 가능성에 직접적으로 영향을 미칩니다.

실용적 함의: 무엇이 바뀌는가?

1. 추론 비용 절감

선형 레이어의 O(n) 복잡도 + MoE의 조건부 연산 + 소수의 attention 레이어. 이 조합은 같은 품질의 응답을 생성하면서도 FLOPs를 크게 줄입니다. API 서비스 사업자에게 이것은 직접적인 마진 개선입니다.

2. 긴 컨텍스트의 실용화

128K 이상의 컨텍스트를 저비용으로 처리할 수 있게 됩니다. 전체 코드베이스 분석, 긴 문서 요약, 멀티턴 대화 같은 작업이 경제적으로 실용적인 영역으로 들어옵니다.

3. 온디바이스 배포

KV-cache 절감은 메모리 제약이 심한 모바일/엣지 디바이스에서의 LLM 배포를 현실화합니다. Nemotron 3 Nano가 NVIDIA Jetson에서 실시간 추론을 보여준 것이 대표적 사례입니다.

4. 학습 인프라 변화

하이브리드 모델의 학습은 순수 Transformer보다 복잡합니다. Mamba/DeltaNet 레이어와 attention 레이어가 서로 다른 병렬화 전략을 요구하기 때문입니다. 이에 맞는 새로운 학습 프레임워크와 커널 최적화가 필요하며, 이 분야에서 NVIDIA의 하드웨어 + 소프트웨어 통합 역량이 더욱 중요해질 것입니다.

결론: 수렴이 말해주는 것

2017년 "Attention is All You Need" 이후, 거의 10년간 Transformer 아키텍처는 논쟁의 여지가 없는 표준이었습니다. 하지만 2026년 3월, 세 독립 팀의 동시 수렴은 새로운 표준의 등장을 알립니다.

핵심 메시지를 정리하면:

- 순수 Transformer의 시대는 끝나가고 있다. O(n^2) 어텐션은 모든 레이어에 필요하지 않습니다.

- 75/25 비율이 새로운 기본값이다. 선형 레이어 75% + 어텐션 25%가 효율과 성능의 균형점입니다.

- MoE는 필수 요소가 되고 있다. 지식 용량과 연산 비용을 분리하는 MoE가 하이브리드의 세 번째 축입니다.

- SSM과 Linear Attention은 같은 패밀리다. Mamba-2를 쓰든 Gated DeltaNet을 쓰든, 수학적으로는 동일한 연산 클래스입니다.

"Attention is All You Need"에서 "Attention is Sometimes What You Need"로의 전환. 이것이 2026년 아키텍처 트렌드의 한 줄 요약입니다.

참고 자료

- NVIDIA Nemotron 3 Nano Technical Report -- Nemotron 3 Nano 아키텍처 상세

- Qwen 3.5 Small Series Blog Post -- Qwen 3.5 Small 시리즈 공개 포스트

- Mamba-3: The Hybrid State Space Model Framework (ICLR 2026) -- 하이브리드 SSM의 이론적 프레임워크

- Mamba: Linear-Time Sequence Modeling with Selective State Spaces -- Mamba 원논문

- Mamba-2: Structured State Space Duality -- Mamba-2 및 SSD 이론

- Gated Delta Networks with Softmax Attention (Yang et al., 2025) -- Gated DeltaNet 원논문

- Attention Is All You Need (Vaswani et al., 2017) -- Transformer 원논문

이메일로 받아보기

관련 포스트

LLM 추론 최적화 Part 4 — 프로덕션 서빙

vLLM과 TGI로 프로덕션 배포. Continuous Batching, Speculative Decoding, 메모리 버짓 설계, 처리량 벤치마크.

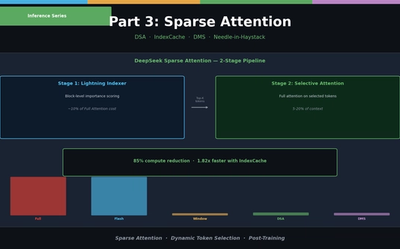

LLM 추론 최적�� Part 3 — Sparse Attention 실전

Sliding Window, Sink Attention, DeepSeek DSA, IndexCache, Nvidia DMS. 동적 토큰 선별부터 Needle-in-Haystack 평가까지.

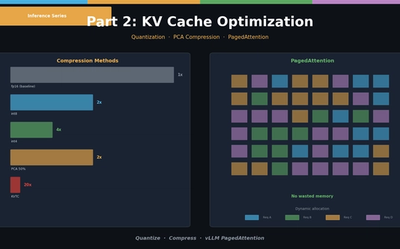

LLM 추론 최적화 Part 2 — KV Cache 최적화

KV Cache 양자화(int8/int4), PCA 압축(KVTC), PagedAttention(vLLM). 실전 메모리 절감 코드와 시나리오별 설정 가이드.