Gemma 4 — 구글이 Apache 2.0으로 풀어놓은 오픈 모델의 새 기준

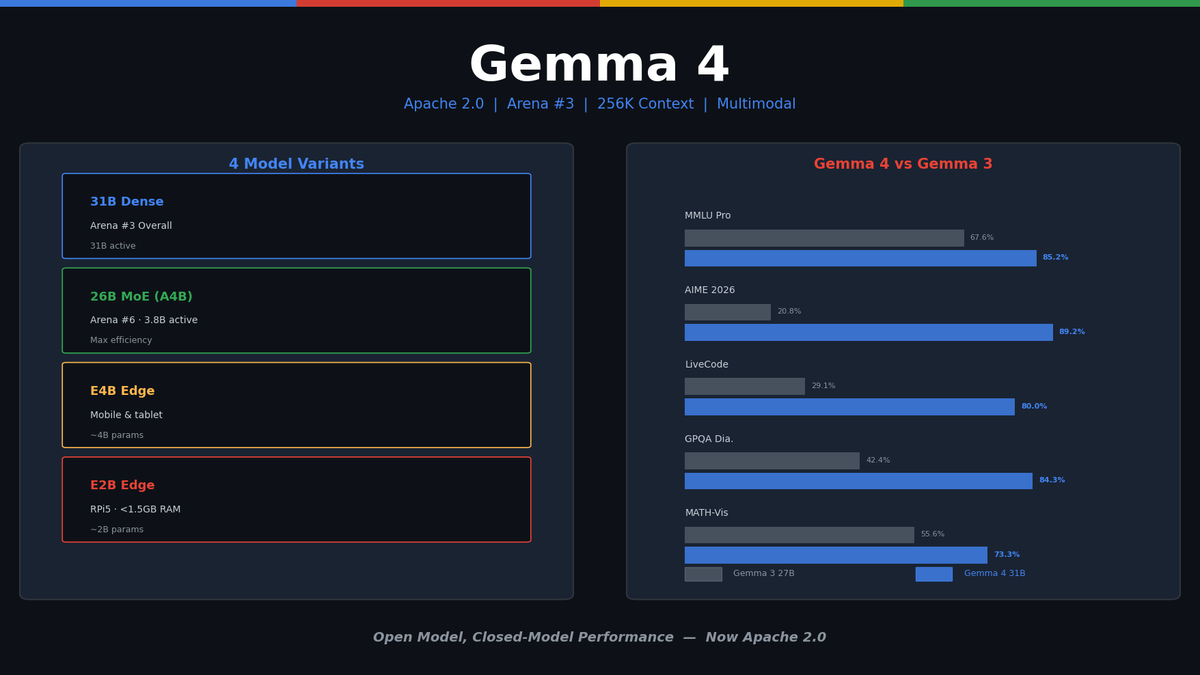

Gemma 시리즈 최초 Apache 2.0 라이선스. Chatbot Arena 전체 3위. 31B Dense, 26B MoE(3.8B 활성), E4B/E2B 에지 모델까지. AIME 89.2%, Codeforces ELO 2150, 256K 컨텍스트, 멀티모달.

Gemma 4: 구글이 Apache 2.0으로 풀어놓은 오픈 모델의 새 기준

2026년 4월 2일, 구글이 Gemma 4를 발표했다. Gemma 시리즈 최초로 Apache 2.0 라이선스를 적용했고, Chatbot Arena에서 전체 3위를 기록하며 오픈 모델의 기준을 다시 썼다.

31B 파라미터 모델이 GPT-4o, Claude 3.5 Sonnet급 성능을 내고, 3.8B 활성 파라미터짜리 경량 모델은 라즈베리파이에서 돌아간다. 4개 모델 변형, 256K 컨텍스트, 멀티모달(텍스트+이미지+오디오) — 하나씩 뜯어보자.

Gemma 4 모델 라인업

| 모델 | 파라미터 | 활성 파라미터 | Arena 순위 | 용도 |

|---|---|---|---|---|

| Gemma 4 31B | 31B (Dense) | 31B | #3 전체 | 최고 성능, 서버/클라우드 |

| Gemma 4 26B (A4B) | 26B (MoE) | 3.8B | #6 전체 | 효율 극대화, 로컬 GPU |

| Gemma 4 E4B | ~4B | ~4B | — | 모바일/에지 |

| Gemma 4 E2B | ~2B | ~2B | — | 초경량 에지, IoT |

핵심 포인트

- Apache 2.0: Gemma 시리즈 최초. 상업적 사용, 수정, 재배포 완전 자유. Gemma 3까지의 제한적 라이선스에서 완전 개방으로 전환.

- MoE 아키텍처: 26B 모델은 총 26B 파라미터 중 3.8B만 활성화. 추론 시 메모리와 연산 비용이 극적으로 줄어든다.

- 256K 컨텍스트: 전 모델 256K 토큰 지원. 긴 문서, 코드베이스 전체 분석 가능.

- 멀티모달: 텍스트, 이미지, 오디오 입력 지원. 네이티브 종횡비 처리.

벤치마크: Gemma 3 대비 얼마나 좋아졌나

Gemma 4 31B vs Gemma 3 27B 비교:

| 벤치마크 | Gemma 3 27B | Gemma 4 31B | 변화 |

|---|---|---|---|

| MMLU Pro | 67.6% | 85.2% | +17.6p |

| AIME 2026 | 20.8% | 89.2% | +68.4p |

| LiveCodeBench v6 | 29.1% | 80.0% | +50.9p |

| Codeforces ELO | 1154 | 2150 | +996 |

| GPQA Diamond | 42.4% | 84.3% | +41.9p |

| MATH-Vision | 55.6% | 73.3% | +17.7p |

AIME 2026에서 89.2%는 충격적이다. Gemma 3가 20.8%였으니 세대 간 격차가 아니라 차원이 다른 수준. 수학 추론 능력이 근본적으로 달라졌다.

Codeforces ELO 2150은 인간 기준 Master 등급. 코딩 벤치마크 전반에서 오픈 모델 중 최고 수준이다.

아키텍처: 무엇이 달라졌나

Dense 모델 (31B)

기본 Transformer 아키텍처에 여러 최적화가 적용됐다:

- 하이브리드 어텐션: Sliding Window Attention + Global Attention 혼합. 로컬 컨텍스트와 전역 컨텍스트를 효율적으로 처리.

- GQA (Grouped Query Attention): Key-Value 헤드를 그룹화해서 메모리 사용량 절감.

- Per-layer Embeddings: 레이어별 독립 임베딩으로 표현력 향상.

- QK/V Normalization: 쿼리-키, 밸류에 정규화 적용. 학습 안정성 개선.

- Proportional RoPE: 위치 인코딩을 비례적으로 적용해 긴 컨텍스트에서 성능 유지.

- Softcapping: Logit 값에 상한을 두어 극단적 확률 분포 방지.

MoE 모델 (26B/A4B)

26B 총 파라미터 중 추론 시 3.8B만 활성화되는 Mixture-of-Experts 구조:

- Expert 레이어가 Dense 레이어 사이에 독립적으로 배치

- 라우터가 입력 토큰에 따라 적절한 Expert를 선택

- 활성 파라미터 대비 성능이 극도로 높음 — Arena #6는 3.8B 활성으로는 전례 없는 성적

에지 모델 (E4B, E2B)

- E2B는 메모리 1.5GB 미만에서 동작

- 라즈베리파이 5 기준: Prefill 133 tok/s, Decode 7.6 tok/s

- 모바일, IoT, 임베디드 디바이스용

경쟁 모델 비교

vs Qwen 3.5 (알리바바)

| Gemma 4 31B | Qwen 3.5 32B | |

|---|---|---|

| 라이선스 | Apache 2.0 | Apache 2.0 |

| Arena 순위 | #3 | ~#8 |

| MMLU Pro | 85.2% | ~82% |

| 코딩 | Codeforces 2150 | ~1900 |

| 멀티모달 | 텍스트+이미지+오디오 | 텍스트+이미지 |

| 에지 모델 | E2B (1.5GB) | 없음 |

Gemma 4가 벤치마크, 에지 라인업, 오디오 지원에서 앞선다.

vs Llama 4 (Meta)

| Gemma 4 31B | Llama 4 Scout | |

|---|---|---|

| 라이선스 | Apache 2.0 | Llama License |

| 아키텍처 | Dense | MoE (17B active/109B) |

| Arena 순위 | #3 | #4 |

| 컨텍스트 | 256K | 10M |

| 에지 모델 | E2B/E4B | 없음 |

Llama 4는 10M 토큰 컨텍스트가 강점이지만, Arena 순위와 라이선스에서 Gemma 4가 유리하다. Meta의 Llama License는 사용자 7억 명 이상일 때 별도 라이선스가 필요하고, 출력으로 경쟁 모델 훈련이 금지된다.

에코시스템: Day-One 지원

출시 당일부터 주요 추론 프레임워크가 지원한다:

- llama.cpp: GGUF 양자화 모델 즉시 사용 가능

- Ollama:

ollama run gemma4한 줄로 로컬 실행 - vLLM: 프로덕션 서빙 최적화

- LM Studio: GUI로 로컬 실행

- transformers.js: 브라우저에서 실행

- Google AI Studio: 무료 API 접근

Ollama로 로컬 실행

# 31B Dense 모델

ollama run gemma4:31b

# 26B MoE 모델 (경량)

ollama run gemma4:26b

# 에지 모델

ollama run gemma4:e2b파인튜닝: LoRA로 한국어 특화

Gemma 4는 140개 이상 언어를 지원하지만, 특정 도메인이나 스타일에 맞추려면 파인튜닝이 필요하다.

Gemma 4의 Apache 2.0 라이선스 덕분에 파인튜닝된 모델의 상업적 배포가 완전히 자유롭다. 이전 Gemma 버전들의 제한적 라이선스와 가장 크게 달라진 점이다.

MoE 모델은 Dense와 LoRA 적용 방식이 다릅니다 — Expert 레이어를 어떻게 타겟하는지, Router는 왜 얼리는지, 학습률은 어떻게 조절하는지가 핵심입니다. 이론부터 실전 코드까지 정리한 시리즈가 아래에 있습니다.

LoRA 파인튜닝 시리즈 — 이론부터 Gemma 4 MoE 실전까지

Part 1~3에서 LoRA 이론, QLoRA, 평가/배포를 다루고, Part 4에서 Gemma 4 MoE Expert 레이어에 LoRA를 적용합니다. 실습 노트북 포함.

누가 쓰면 좋은가?

Gemma 4 31B (Dense):

- 최고 성능이 필요한 프로덕션 서비스

- RAG 파이프라인, 코드 생성, 복잡한 추론

- GPU 서버 환경 (A100/H100)

Gemma 4 26B/A4B (MoE):

- 로컬 GPU에서 고성능이 필요한 경우

- RTX 4090 하나로 돌릴 수 있는 최강 모델

- 비용 대비 성능 극대화

Gemma 4 E4B/E2B (Edge):

- 모바일 앱 내장

- IoT/임베디드 시스템

- 오프라인 동작이 필요한 환경

마무리

Gemma 4는 세 가지 면에서 의미가 크다:

- Apache 2.0: 오픈 모델 라이선스의 새 기준. 상업적 제약 없이 자유롭게 사용, 수정, 배포 가능.

- 성능: Arena #3는 오픈 모델이 클로즈드 모델과 정면 대결할 수 있다는 증거.

- 에지 라인업: 1.5GB 미만으로 라즈베리파이에서 돌아가는 모델까지 — 디바이스 AI의 실질적 시작.

특히 MoE 모델(26B/A4B)의 효율성이 인상적이다. 3.8B 활성 파라미터로 Arena #6는 파라미터 효율의 새로운 기준점이다. 로컬 환경에서 고성능 LLM을 돌리고 싶은 개발자에게 가장 매력적인 선택지가 될 것이다.

참고 자료

관련 포스트

스스로 진화하는 AI 에이전트 — 2026년의 새로운 패러다임

GenericAgent, Evolver, Open Agents — 스스로 스킬을 만들고, 실행 경로를 기억하고, 실패에서 배우는 자가 진화 에이전트 3종 비교.

나만의 LLM Knowledge Base 구축하기 — Karpathy 스타일 지식 시스템

Obsidian + Claude Code로 영구적인 개인 지식 체계를 만드는 완전 가이드. 위키 + 메모리 두 축의 지식 시스템.

Karpathy의 CLAUDE.md가 48K 스타를 받은 이유 — 그리고 나만의 CLAUDE.md 작성법

마크다운 파일 하나로 AI 코딩 정확도를 65%에서 94%로. Karpathy의 4가지 규칙과 실전 작성법을 분석합니다.