RAG Evaluation: Precision/Recall을 넘어서

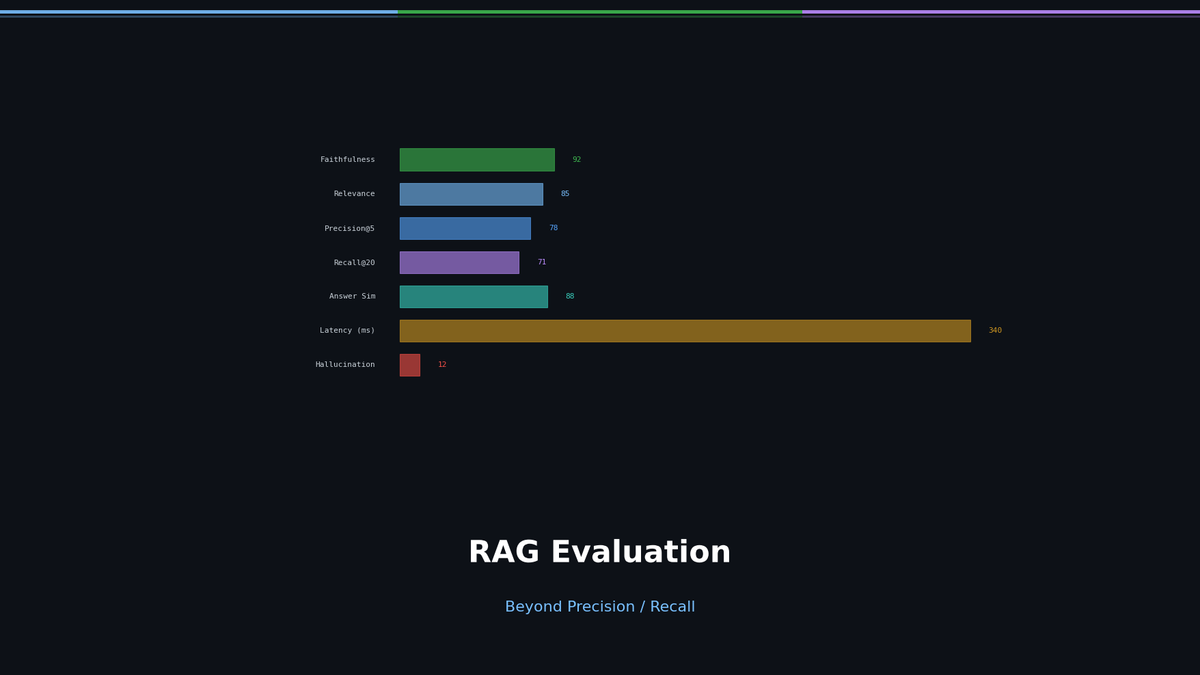

"RAG가 잘 동작하는지 어떻게 알죠?" — Precision/Recall만으로는 부족합니다. Faithfulness, Relevance, Context Recall까지 측정해야 진짜 품질이 보입니다.

RAG Evaluation: Precision/Recall을 넘어서

"RAG가 잘 동작하는지 어떻게 알죠?" — Precision/Recall만으로는 부족합니다. Faithfulness, Relevance, Context Recall까지 측정해야 진짜 품질이 보입니다.

왜 기존 메트릭으로 부족한가?

전통적인 IR(Information Retrieval) 메트릭:

| 메트릭 | 측정 대상 | RAG에서의 한계 |

|---|---|---|

| Precision@K | 상위 K개 중 관련 문서 비율 | 답변 품질과 무관할 수 있음 |

| Recall@K | 전체 관련 문서 중 검색된 비율 | Ground truth 필요, 현실적으로 힘듦 |

| MRR | 첫 관련 문서 순위 | 여러 문서 필요한 경우 무의미 |

관련 포스트

AI Tools & Agents

스스로 진화하는 AI 에이전트 — 2026년의 새로운 패러다임

GenericAgent, Evolver, Open Agents — 스스로 스킬을 만들고, 실행 경로를 기억하고, 실패에서 배우는 자가 진화 에이전트 3종 비교.

AI Tools & Agents

나만의 LLM Knowledge Base 구축하기 — Karpathy 스타일 지식 시스템

Obsidian + Claude Code로 영구적인 개인 지식 체계를 만드는 완전 가이드. 위키 + 메모리 두 축의 지식 시스템.

AI Tools & Agents

Karpathy의 CLAUDE.md가 48K 스타를 받은 이유 — 그리고 나만의 CLAUDE.md 작성법

마크다운 파일 하나로 AI 코딩 정확도를 65%에서 94%로. Karpathy의 4가지 규칙과 실전 작성법을 분석합니다.