LLM 추론 최적화 Part 1 — Attention 메커니즘 해부

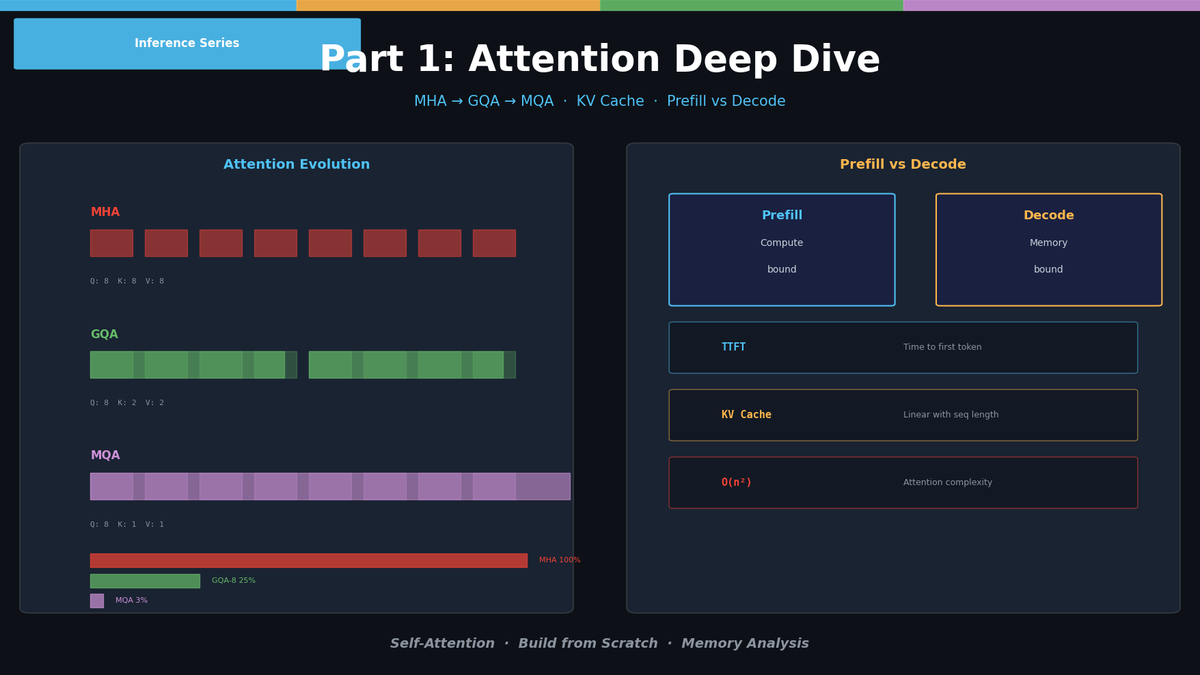

Self-Attention을 밑바닥부터 구현. MHA → GQA → MQA 진화를 코드로 비교. KV Cache 동작 원리와 Prefill vs Decode 분석.

LLM 추론 최적화 Part 1 — Attention 메커니즘 해부

LLM을 실제 서비스에 배포하면 가장 먼저 부딪히는 벽은 추론 속도와 메모리입니다. 모델이 아무리 좋아도 느리고 비싸면 쓸 수 없습니다. 이 시리즈에서는 LLM 추론의 핵심 병목을 하나씩 해부하고, 실전 최적화 기법을 코드와 함께 다룹니다.

Part 1에서는 모든 최적화의 출발점인 Attention 메커니즘을 밑바닥부터 구현하고, MHA → GQA → MQA의 진화를 코드로 직접 비교합니다.

Self-Attention — 처음부터 구현

기본 구조

관련 포스트

AI Tools & Agents

스스로 진화하는 AI 에이전트 — 2026년의 새로운 패러다임

GenericAgent, Evolver, Open Agents — 스스로 스킬을 만들고, 실행 경로를 기억하고, 실패에서 배우는 자가 진화 에이전트 3종 비교.

AI Tools & Agents

나만의 LLM Knowledge Base 구축하기 — Karpathy 스타일 지식 시스템

Obsidian + Claude Code로 영구적인 개인 지식 체계를 만드는 완전 가이드. 위키 + 메모리 두 축의 지식 시스템.

AI Tools & Agents

Karpathy의 CLAUDE.md가 48K 스타를 받은 이유 — 그리고 나만의 CLAUDE.md 작성법

마크다운 파일 하나로 AI 코딩 정확도를 65%에서 94%로. Karpathy의 4가지 규칙과 실전 작성법을 분석합니다.